Travailler en équipe avec l’IA devient un enjeu managérial majeur, à mesure que ces outils s’installent dans les pratiques professionnelles. Pour les managers, il ne s’agit plus de freiner ou de laisser faire, mais de poser un cadre opérationnel. Comment répartir les rôles entre collaborateurs et IA, sécuriser les usages et maintenir la responsabilité sur les livrables ? Découvrez des repères concrets pour transformer l’IA en alliée du travail collectif et de la performance durable, avec Gauthier Lamothe, entrepreneur expérimenté et formateur en IA adaptée au management.

L’intelligence artificielle générative s’est imposée rapidement dans le quotidien des équipes professionnelles. Selon McKinsey, près de 80 % des organisations mondiales utilisaient des outils d’IA générative en 2025, contre 65 % un an plus tôt et 33 % en 2023. Mal encadrée, cette adoption expose les entreprises à des risques de qualité, de sécurité des données et de responsabilité. Bien intégrée collectivement, l’IA devient au contraire un levier puissant de performance.

Voici des repères concrets pour :

- travailler efficacement en équipe avec l’IA

- clarifier les rôles humains et automatisés

- sécuriser les usages dans un cadre professionnel

Pourquoi travailler en équipe avec l’IA ?

Dans de nombreuses organisations, l’IA générative est soit interdite, soit tolérée sans cadre clair. Une enquête Cisco de 2024 montre que 27 % des entreprises ont initialement interdit les outils d’IA générative, tandis que 63 % ont restreint les types de données pouvant y être soumis. Pourtant, ces interdictions ne reflètent pas les usages réels.

Selon une étude Gartner publiée début 2025, 69 % des salariés utilisent des outils d’IA sans validation officielle lorsque leur entreprise ne leur fournit pas de solution adaptée. Ce phénomène de shadow IA crée un décalage entre les règles formelles et la pratique quotidienne des équipes.

Intégrer l’IA de manière collective consiste donc à dépasser une logique binaire. Il ne s’agit ni de tout interdire, ni de tout déléguer, mais de définir un cadre partagé, aligné sur les usages réels et les objectifs métiers.

[Formation]

Et si l’intelligence artificielle devenait votre meilleure alliée pour un management plus humain et plus efficace ? La formation Managers, gagner en performance avec l’IA vous permettra de découvrir comment tirer parti de l’intelligence artificielle pour optimiser la gestion de votre équipe au quotidien, tout en renforçant la proximité, la communication et la prise de décision éthique.

Clarifier les rôles : ce que l’IA peut faire et ce qu’elle ne doit pas faire

L’IA générative peut être considérée comme un coéquipier augmenté. Elle accélère certaines tâches, mais elle ne peut ni décider ni assumer une responsabilité professionnelle. La CNIL rappelle en effet que la décision finale et la responsabilité associée restent toujours humaines. Ainsi, les personnes responsables de la sélection de la base de données peuvent être de facto désignées comme responsables du traitement de la donnée. Elles doivent donc s’assurer du respect des réglementations (responsabilité en cas de manquements).

Répartition des rôles recommandée pour travailler en équipe avec l’IA

| Type de tâche | Apport de l’IA | Rôle humain indispensable |

| Rédaction | Génération de brouillons, reformulation | Validation du fond et du ton |

| Analyse | Propositions de pistes, synthèses | Choix, arbitrage, interprétation |

| Décision | Simulation de scénarios | Responsabilité finale |

| Données | Mise en forme, résumé | Vérification de la fiabilité |

Cette clarification limite les illusions de délégation totale et sécurise la production collective de livrables.

[Témoignage]

« L’IA est un formidable outil pour suggérer des pistes de développement de nos nouveaux produits : elle nous permet même parfois d’innover en fonction de nos stocks de matériaux restants. Mais à chaque fois que nous n’avons pas vérifié scrupuleusement ses propositions, de petites erreurs s’étaient glissées dans les raisonnements. Si nous n’avions pas cette rigueur de travail qui consiste à vérifier, une bonne partie des produits que nous concevons en étant assistés par l’IA auraient été défectueux ou construits selon un cahier des charges impraticable, donc inexploitables commercialement. »

Michael Ronsin – Responsable spécifications produit pour la marque Hookook

Travailler en équipe avec l’IA : en transparence, avec un cadre d’usage partagé

Pour encadrer les usages de l’IA, de nombreuses organisations mettent en place des chartes d’utilisation. La CNIL fournit également de nombreuses ressources pour que les entreprises agissent conformément au RGPD, que ce soit dans l’usage de l’IA avec des données de clients, ou dans l’entraînement d’IA personnalisées.

Principes clés d’une charte d’usage responsable

- Adapter l’outil au niveau de sensibilité des données

- Rendre les usages visibles et partagés au sein de l’équipe

- Différencier les cas d’usage selon les métiers

Exemple de cadre opérationnel

| Type de données | Outil recommandé | Règle associée |

| Données confidentielles | IA interne sécurisée | Usage strictement encadré |

| Données anonymisées | IA publique (ChatGPT, Gemini, etc.) | Transparence entre équipes |

| Données publiques | IA publique | Usage libre |

Ce type de cadre est plus efficace que les interdictions générales, souvent contournées, et permet de réduire significativement les risques de fuite ou de mauvaise utilisation des données.

« En formation, j’ai tendance à dire aux participants que lorsqu’on utilise une IA publique, on prend mais on ne donne rien en termes d’information. »

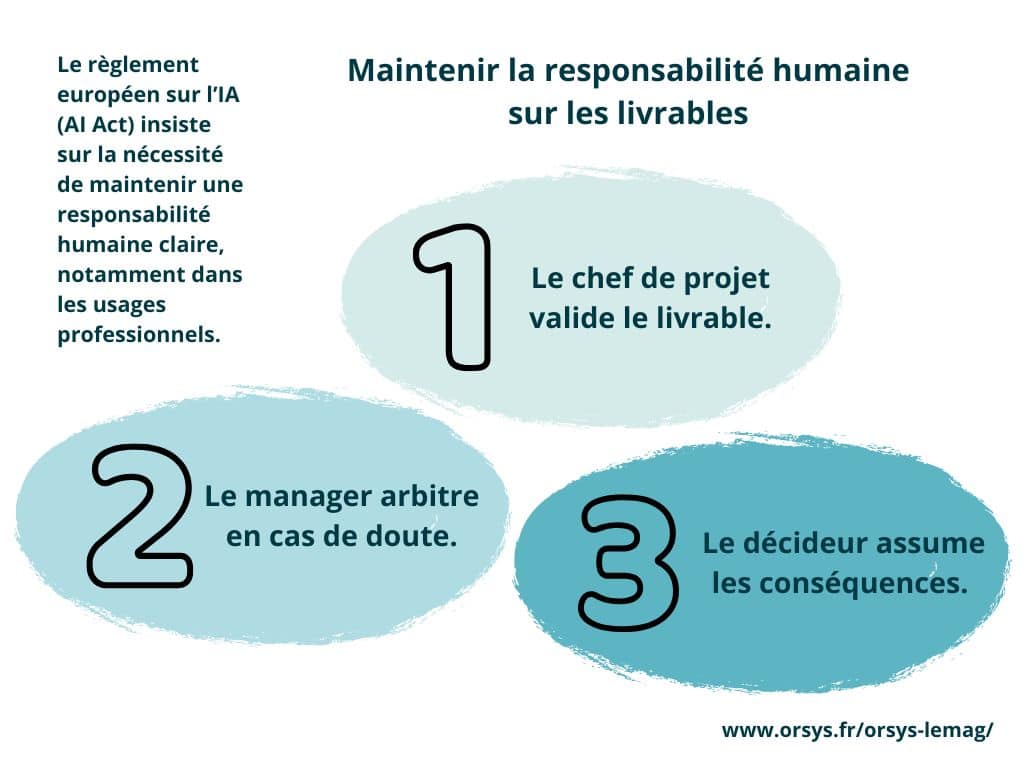

Maintenir la responsabilité humaine sur les livrables

Un principe fait consensus dans les recommandations européennes et françaises : un livrable produit avec l’IA engage toujours une personne identifiée. Le règlement européen sur l’IA (AI Act) insiste sur la nécessité de maintenir une responsabilité humaine claire, notamment dans les usages professionnels.

En pratique :

- le chef de projet valide le livrable

- le manager arbitre en cas de doute

- le décideur assume les conséquences

Cette règle simple sécurise les processus et préserve la confiance au sein des équipes et avec les clients.

Encourager l’itération collective plutôt que l’usage individuel

Les usages les plus efficaces de l’IA sont collectifs. Selon le MIT Sloan Management Review en collaboration avec le Boston Consulting Group, les organisations qui encadrent l’IA via des pratiques partagées obtiennent de meilleurs résultats que celles qui laissent chaque collaborateur expérimenter isolément.

Certaines équipes mettent ainsi en place des bibliothèques de prompts partagées, documentant les usages efficaces par métier. C’est une bonne pratique, mais sous deux conditions :

1/ inclure une chaîne de prompts et pas un seul trop chargé

2/ les soumettre à une revue d’expert

C’est en effet l’expertise d’un collaborateur qui permet de voir que la même question dans deux contextes différents produira un livrable tantôt satisfaisant, tantôt inexploitable.

Bonnes pratiques

- Documenter les prompts par cas d’usage

- Identifier les limites et points de vigilance

- Mettre à jour régulièrement les versions

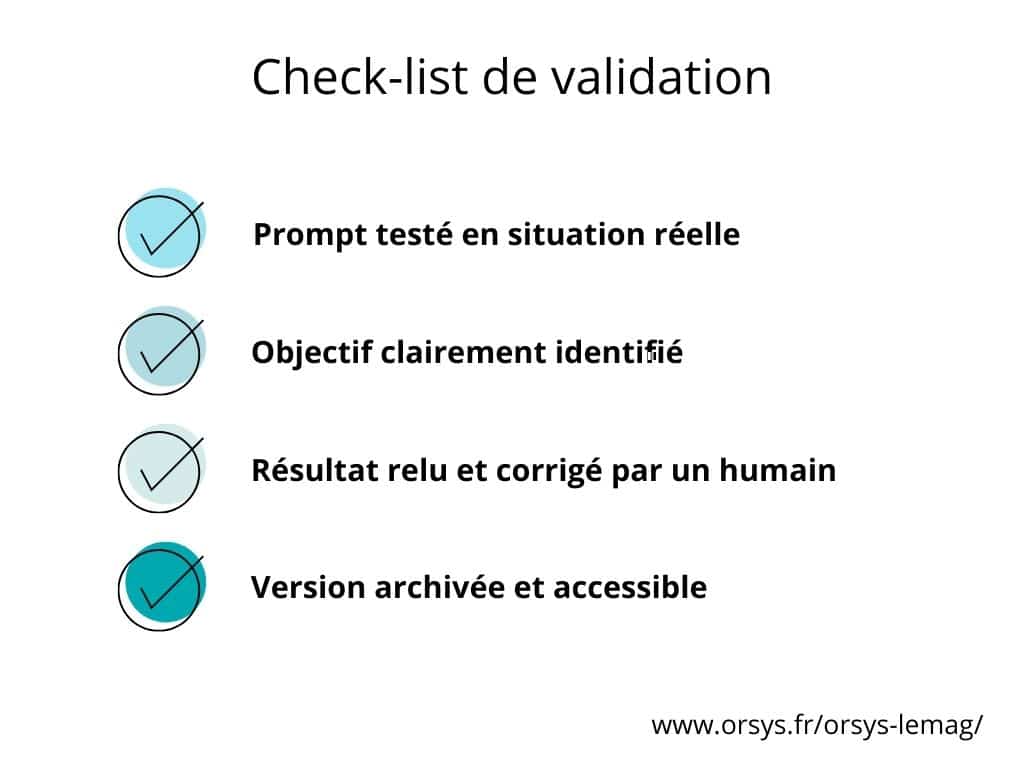

Check-list de validation

- Prompt testé en situation réelle

- Objectif clairement identifié

- Résultat relu et corrigé par un humain

- Version archivée et accessible

Cette approche favorise une qualité homogène des livrables et une montée en compétence collective.

[Formation]

Le prompt engineering vise à optimiser la communication avec les modèles d’intelligence artificielle génératifs. Vous voulez créer des prompts efficaces afin de générer des réponses spécifiques ou accomplir des tâches précises ? Découvrez le programme de la formation Prompt engineering, communiquer efficacement avec les intelligences artificielles.

Respecter la durée réelle du travail

L’IA permet d’accélérer certaines tâches, mais elle ne supprime pas la complexité du travail professionnel. Une étude du MIT montre que les professionnels utilisant l’IA gagnent en moyenne 30 à 40 % de temps sur des tâches intermédiaires, mais que les phases d’analyse, de décision et de validation restent incompressibles.

Par exemple :

Une analyse stratégique nécessitant deux jours de travail humain ne peut pas être produite de manière fiable en dix minutes. En revanche, l’IA peut accélérer la structuration, la recherche d’idées ou la mise en forme intermédiaire.

Reconnaître cette réalité évite des attentes irréalistes et des déceptions opérationnelles.

Travailler en équipe avec l’IA : exemples d’usages par secteur

| Secteur | Usage de l’IA | Validation humaine |

| Marketing | Génération de variantes de campagnes | Équipe créative |

| Ressources humaines | Proposition de grilles d’entretien | Recruteur |

| Juridique | Simplification de contrats | Avocat |

| Finance | Visualisation et synthèse de données | Analyste |

| IT | Proposition de code ou documentation | Développeur |

Dans tous les cas, l’IA assiste, l’humain décide et assume.

En définitive, travailler en équipe avec l’IA nécessite méthode, transparence et responsabilité. Utilisée comme un coéquipier augmenté, l’IA renforce la performance collective. Utilisée sans cadre, elle amplifie les fragilités existantes de l’organisation. Mettre en place des pratiques partagées permet aux équipes de tirer pleinement parti de l’IA tout en conservant la maîtrise de leurs décisions, de leurs données et de leurs livrables.